Etica e robotica

I robot, maschere del desiderio umano

Da quale punto di vista parliamo noi eticisti? E per chi? Quali sono le conseguenze e quale è il (potenziale) campo di applicazione di un’etica dell’interazione umana con i sistemi robotici, bionici e di comunicazione? (che di seguito chiameremo tecno-etica?). Una sua parte importante può essere considerata un’etica della progettazione e della produzione tecnologica.

La tecno-etica deve stare alla base di una forte pratica democratica e dell’azione civica che viene coinvolta nella creazione di artefatti tecno-scientifici.

La questione cruciale è come concepire un processo interdisciplinare che coinvolga nella discussione in atto anche ingegneri e tecnici.

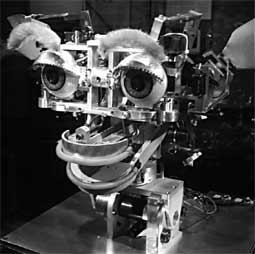

Il robot AIBO

Una seconda questione è se o come sia possibile (e auspicabile) sviluppare un’etica generale per qualsiasi tipo di robot e di attori. In quale caso (casi) ci serve una diversificazione dei campi di applicazione e dei tipi di robot/attori rispetto ai problemi etici? A livello socio-tecnico i robot sono descritti come “macchine sensomotorie che aumentano l’abilità umana al movimento. Essi consistono di componenti meccatronici, di sensori e di funzioni guida controllate dal computer. La complessità di un robot è maggiore di quella di altre macchine per via del suo più alto grado di libertà e della sua molteplicità e quantità di comportamenti.” (Christaller et al. 2001, tradotto da Jutta Weber).

Altra questione rilevante da discutere è se vi sia una differenza qualitativa fra macchine classiche, transclassiche e sistemi autonomi.

Una terza questione dovrebbe essere cui bono?

Per chi e da chi sono sviluppati i robot?

Chi stabilisce gli standard di robot e dispositivi robotici come AIBO, PINO, PARO, KISMET e altri? Possono contribuire a una più profonda uguaglianza, a un più intenso apprezzamento di una molteplicità eterogenea e a una più forte responsabilità verso mondi vivibili?

Oltre a ciò è necessaria una riflessione sul contesto socio-culturale del dibattito sui robot e sugli attori. Che tipo di conflitti sociali e di relazioni di potere sono interconnessi nella produzione e nell’uso di attori e robot? In che modo entra in gioco il rapporto fra scienza, tecnologia, industria e politica? Che dire dell’interesse militare per la robotica e per gli attori?

Ultimo, ma non meno importante, compito centrale per la tecno-etica è quello di imparare la lezione dalla discussione sulla bioetica. Per esempio: dovremmo evitare discussioni astratte sull’agire o sull’intenzionalità dell’agire e dei robot e dovremmo riflettere se siano utili a risolvere il contesto sullo sviluppo e sull’uso futuro di attori e robot.

Il robot PINO

L’uso massiccio dei robot cambierà la società probabilmente in modo simile a come hanno fatto le automobili e gli aeroplani e in effetti ha già cambiato la società - basti pensare ai robot industriali nel posto di lavoro che sono un fattore importante rispetto alla crescente disoccupazione in Europa. Quest’ampia visione dei cambiamenti sociali e di conseguenza delle nostre opinioni, compresi i nostri valori morali, è fondamentale. Potrebbe essere necessaria una ridefinizione di ciò che significa essere umani. Per esempio, la Carta europea dei diritti umani è incentrata sull’uomo. L’uso massiccio dei robot potrebbe rappresentare una sfida per questa prospettiva antropocentrica.

Perché vogliamo vivere con i robot? Perché viviamo con i robot? Ci sono vari livelli di riflessione quando si risponde a queste domande, iniziando da quella triviale secondo cui i robot possono essere molto utili e pertanto indispensabili, ad esempio nella produzione industriale odierna, o quando si ha a che fare con situazioni in cui i pericoli per gli esseri umani sono grandi. Ma prima di fare una riflessione in questa direzione vediamo la prospettiva di quello che René Girard chiama “desiderio mimetico” (Girard 1972).

Il rapporto tra esseri umani e robot può essere concepito come un rapporto di invidia in cui gli umani invidiano i robot per quello che sono oppure invidiano gli altri umani perché hanno robot che essi non hanno. Nel primo caso, l’invidia può essere positiva se il robot è considerato anche come un modello da imitare o negativa se il rapporto degenera in rivalità.

Quest’ultima possibilità è esemplificata in molti film e romanzi di fantascienza in cui i robot e gli umani si suppone competano.

I robot sono dunque spesso rappresentati come androidi senza emozione, privi di senso morale e pertanto meno “validi” degli umani. Controesempi sono per esempio 2001 Odissea nello spazio (Stanley Kubrick 1968) o il romanzo di Stanislaw Lem, Golem XIV (Lem 1981).

Il conflitto mimetico sorge non solo dal fatto di imitare ciò che un robot può fare, ma più in generale dal fatto di imitare ciò che si suppone “esso” desideri.

Ma i desideri di un robot paradossalmente sono i nostri poiché noi siamo i creatori. Le opinioni positive e negative sui robot fanno luce sull’autocomprensione umana che conduce all’idea di migliorare le capacità umane, per esempio impiantando dispositivi artificiali nel corpo umano.

Il robot KISMET

Quando i robot sono usati dagli umani per diversi scopi ciò crea una situazione in cui il “desiderio mimetico” è articolato sia come una questione di giustizia (un futuro “robot divide”) o come una nuova specie di invidia.

Questa volta l’oggetto dell’invidia non è il robot stesso ma l’altro umano che lo usa/lo possiede. Il dilemma etico fondamentale rispetto ai robot è pertanto non solo la questione del loro buono o cattivo utilizzo, bensì la questione del nostro rapporto con il nostro stesso desiderio, con tutto il suo dinamismo mimetico creativo e distruttivo che comprende non solo strategie come l’invidia, la rivalità e il modello da seguire, ma anche il loro uso banale come strumento che può anche diventare una questione di giustizia sociale.

I robot possono essere visti come maschere del desiderio umano. Il nostro “desiderio mimetico” potrebbe influenzare (ma quanto?) il loro valore di scambio nel mercato.

La nostra storia d’amore con essi apre un rapporto a doppio legame che include l’intera gamma delle passioni umane, dall’indifferenza alla rivalità e alla violenza passando dall’idealizzazione anche se questo potrebbe non essere il caso rispetto allo stato dell’arte contemporaneo nella robotica poiché i robot ancora sono privi di intelligenza e di un comportamento non prevedibile. È compito della riflessione etica andare oltre la dimensione economica al fine di scoprire il meccanismo che rende possibile l’invenzione, la produzione e l’uso di robot di tutti i tipi. Questi meccanismi sono basati sulle passioni mimetiche umane relative sia a un individuo che a una scala sociale. In senso mitico i robot sono vissuti dalla nostra società tecnologica e secolarizzata come capro espiatorio per il quale si concepisce l’“umanità” del genere umano la cui espressione più alta e globale è la Dichiarazione universale dei diritti dell’uomo. Da questa prospettiva mitica i robot sono la buona e la cattiva coscienza di noi stessi.

Ci offrono la possibilità di un discorso morale su noi stessi ma nello stesso tempo distolgono la nostra attenzione dalla intollerabile situazione di violazione di tali diritti rispetto ai veri esseri umani. In altre parole una riflessione etica sui robot deve tenere conto di queste insidie, in particolare quando si considerano i pericoli del desiderio mimetico rispetto alla dignità umana, all’autonomia o alla protezione dei dati. Essa deve riflettere il rapporto a doppio legame tra umani e robot.

Se i robot rispecchiano il nostro desiderio mimetico dobbiamo sviluppare strategie individuali e sociali al fine di smascherare l’oggetto irraggiungibile per cui ci battiamo che si trasforma in pericolo quando assomiglia alla realizzazione in vista della quale tutto, compresi noi stessi, dovrebbe essere visto come un mezzo per un fine.

Il concetto di dignità umana è un marchio distintivo sopra e oltre il nostro stesso desiderio. È un marchio di autotrascendenza indipendentemente dalle promesse tecnologiche e/o religiose. Ci consente di evitare barriere ideologiche o fondamentaliste regolando nello stesso tempo la dinamica del desiderio mimetico.

Il concetto di robot è ambiguo.

Secondo Karel Čapek che ha coniato per primo il termine, un robot è un dispositivo artificiale simile all’uomo, un androide, capace di eseguire autonomamente, vale a dire senza la permanente guida umana, diversi tipi di compiti in particolare nel campo della produzione industriale. I robot antropomorfici, ma anche i dispositivi artificiali che imitano diversi tipi di esseri umani, hanno una lunga tradizione. Gli odierni robot industriali spesso non sono simili all’uomo. C’è tensione tra prodotti artificiali tecnoidi e naturoidi (Negrotti 1995, 1999, 2002). Il concetto stesso di artificiosità è collegato a qualcosa che viene prodotto dalla natura e imitato dall’uomo. Creare qualcosa di simile ma non identico a un prodotto naturale significa che qualsiasi cosa possa qualificarsi come artificiale fa la differenza rispetto al naturale o all’originale (Negrotti). I robot sono per lo più concepiti come attori fisici. Con il sorgere della tecnologia informatica sono stati sviluppati softbots (fusione di software e robots, sono robot virtuali che navigano nella rete in grado, per esempio, di selezionare informazioni specifiche su un argomento richiesto) o agenti software che hanno un impatto anche nel mondo fisico tanto che è difficile tracciare un confine chiaro. È il caso dell’ibridazione fra umani e robot (cyborgs). In effetti non solo gli individui, ma l’intera società è interessata da un processo di cyborgization.

Un modello di robot industriale

Cosa sono i robot?

Sono prodotti dei sogni umani (Brun 1992, Capurro 1995).

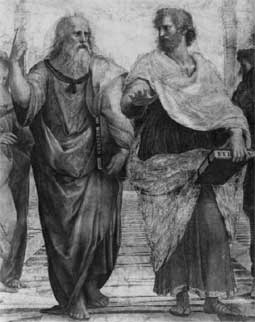

Ogni idea di robot implica l’oggetto nascosto del nostro desiderio. I robot sono pertanto le immagini degli dei (dal greco: agalma) dentro la maschera di un satiro. Secondo l’interpretazione psicoanalitica di Jacques Lacan (Lacan 1991), seguendo il racconto platonico dell’incontro amoroso tra Socrate e Alcibiade nel Symposio (222), questi “piccoli oggetti” sono l’obiettivo irraggiungibile e impossibile del desiderio umano.

Platone nel Timeo descrive l’opera del demiurgo che plasma il mondo a immagine (agalma) del divino come un’opera di gioia e pertanto uno stimolo a fare la copia più simile all’originale (parádeigma) (37c).

Insomma, i nostri valori o l’obiettivo del nostro desiderio sono immersi in tutti i nostri dispositivi tecnologici e in particolare nel tipo di prodotti in cui si mimetizza la nostra identità umana. Perciò la questione non è solo quali valori stiamo cercando di realizzare attraverso essi ma perché lo stiamo facendo?

I robot sono uno specchio di valori culturali condivisi che mostrano a noi e agli altri chi vogliamo essere. Noi ridefiniamo noi stessi in confronto con i robot allo stesso modo in cui redefiniamo noi stessi rispetto agli animali o agli dei. Queste ridefinizioni hanno implicazioni di carattere economico e culturale di vasta portata.

Ma chi è il “noi” di questa specie di discorso psicoanalitico?

Che dire di una cultura dell’ingegneria che è principalmente coinvolta nello sviluppo e nella progettazione di robot? Negli approcci di genere “noi” rivendichiamo una cultura maschile della produzione tecnologica. Così tutte le persone hanno lo stesso tipo di rapporto a doppio legame con i robot.

E che dire delle differenze culturali?

Come si vive in un ambiente tecnologico?

Qual è l’impatto dei robot sulla società?

In che modo, noi, in qualità di utenti, trattiamo i robot?

Quali metodi e mezzi sono oggi utilizzati per impostare l’interfaccia uomo-macchina?

Che cosa pensare del mimetismo delle emozioni e degli stereotipi delle norme sociali?

Che tipo di linguaggio/retorica viene usato nel descrivere la problematica di attore e macchina - e qual è quello che vogliamo usare?

Nel campo dell’intelligenza artificiale e della robotica incontriamo spesso un impiego piuttosto approssimativo del linguaggio, che corrobora la tesi di agenti antropomorfizzanti.

Questo linguaggio implica spesso l’intenzionalità e l’autonomia degli attori - per esempio come in tutti quei casi in cui i ricercatori parlano dell’apprendimento, delle esperienze, delle emozioni, della capacità di saper prendere decisioni (e così via) degli attori.

In che modo andremo allora a trattare questa problematica in ambito scientifico e nelle nostre pratiche sociali?

I robot non sono prodotti belli e pronti all’uso, di ingegneri e informatici, bensì dispositivi e tecnologie emergenti che prendono forma nel corso della loro realizzazione. Quali sono le conseguenze del fatto che oggi i dispositivi ICT (Tecnologie dell’informazione) sono esclusivamente messi a punto da ingegneri e da informatici? Qual è il significato del rapporto servo-padrone rispetto ai robot?

E quale quello di robot quale partner di contesti e scenari diversi?

L’attuale ricerca sui robot sociali sta concentrando tutta la sua attenzione sulla creazione di sistemi interattivi che siano in grado di riconoscere gli altri, interpretarne i gesti e le espressioni verbali, che riconoscano ed esprimano emozioni e che siano dotati di capacità di apprendimento sociale. Un quesito centrale concernente la robotica sociale è in che modo la creazione di certe tecnologie può forgiare la comprensione di noi stessi e come queste tecnologie hanno impatto sulla società. Per comprendere le implicazioni di certi sviluppi è importante analizzare i concetti principali della robotica sociale, quali il sociale, la sociabilità, le interazioni di natura e stile umani. Le domande principali sono, allora: Quali concetti della sociabilità vengono tradotti in azione dalla robotica sociale?

In che modo il comportamento sociale viene concettualizzato, plasmato e reso instaneo nei processi di implementazione software? E quali sono i tipi di comportamento sociale cui vogliamo dare forma per implementarli in artefatti?

Esiste la tendenza a mettere a punto robot programmando questi ultimi sulla base di alcuni aspetti del comportamento umano piuttosto che quella a realizzarli sulla fattispecie di un vero e proprio androide (Arnall 2003). Il raggiungimento di una relativa autonomia è un traguardo pensato sia per i physical robots, sia per i softbots.

Qual è il significato di autonomia in robotica?

Quali sono le affinità e quali le differenze se affrontiamo il discorso dal punto di vista della robotica e da quello filosofico?

Evidentemente sperimenteremo un forte spostamento bidirezionale del concetto di autonomia (come di quello di sociabilità, emozione e intelligenza) tra discorsi e discipline così tanto diversi.

In che modo il trasferimento di concetto tra le discipline - e soprattutto il forte impatto della robotica - modifica i significati tradizionali di concetti, quali autonomia, socializzazione, emozione e intelligenza?

Facendo riferimento alla Carta dei dirittifondamentali dell’Unione Europea (artt. 1, 3, 6, 8, 25, 26) possono sorgere le seguenti domande: Chi è da ritenersi responsabile per i risultati indesiderati nelle azioni compiute da gruppi ibridi uomo-macchina?

In quale modo gli attoridell’intelligenza artificiale devono regolare il monitoraggio e l’elaborazione dei dati? Gli impianti bionici possono essere usati per accrescere le capacità fisiche e mentali, piuttosto che per ripristinarle?

Tutte e tre le domande affrontano possibilità che hanno un effetto immediato sui singoli esseri umani poiché la responsabilità è tradizionalmente attribuita ai singoli attori (compresi gli individui); il diritto dell’uomo alla privacy tutela la capacità di vivere in maniera autonoma; i miglioramenti sono ad esclusivo beneficio della singola persona. Tuttavia, l’importanza dell’integrazione uomo-robot va oltre il livello del singolo individuo e affronta la questione su come la società o la comunità potrebbe e dovrebbe quanto più assomigliare alle modalità in cui i robot vengono integrati.

Probabilmente solo alcuni membri di una collettività o comunità potranno interagire con certi tipi di robot; si pensi ad esempio ai robot programmati per il divertimento dei ricchi, o per l’assistenza agli anziani e ai malati e così via. Questo tipo di interazione con le macchine potrebbe anche costruire nuove forme di comunità.

Un’attenzione particolare dovrebbe essere prestata all’individuazione di quali gruppi di persone potrebbero verosimilmente essere capaci di interagire con alcuni tipi di robot, in un certo contesto, mantenendo, al tempo stesso, la prospettiva dell’impatto delle specifiche interazioni su quelle comunità e società in cui queste forme specifiche di interazione hanno luogo.

Tutte e tre le forme di integrazione uomo- robot possono includere sia aspetti che violano, sia altri che sostengono i diritti e la dignità umani. D’altronde, si sa che la stessa tecnologia ha sia effetti positivi che negativi. Le infrastrutture di sorveglianza possono essere considerate deleterie in fatto di privacy, ma possono anche permetterci di creare nuovi tipi di comunità.

I potenziali benefici o danni possono essere arrecati da certe forme di integrazione uomo-robot.

In che modo allora far scomparire i conflitti derivanti, soprattutto nel caso in cui esista un conflitto tra la prospettiva individuale e quella di una società o comunità? Certi miglioramenti potrebbero essere considerati un beneficio per l’individuo ma anche sollevare nuove domande, ad esempio: soltanto un’élite di persone potrebbe essere in grado di trasformarsi in organismi bionici? O - nella peggiore delle ipotesi - i disoccuppati dovrebbero per forza possedere dei dispositivi particolari, tali da consentire loro di compiere determinate attività lavorative?

Platone e Aristotele nel dipinto La scuola di Atene di Raffaello - città del Vaticano

Al momento non è necessario affrontare il discorso se i robot devono essere visti come persone. Le attuali questioni etiche fanno della responsabilità umana il problema fondamentale, che deve essere affrontato sulla base di un’indagine morale sulla tecno-etica. Tutto ciò può comportare domande del tipo: Chi e come - conformemente a quali principi - dovrebbe imputare delle responsabilità (e a chi) nei casi che comportano l’integrazione uomo-robot? E quali dovrebbero essere le conseguenze di una tale ascrizione? Chi è responsabile della progettazione e del mantenimento di una infrastruttura in cui le informazioni delle persone vengono raccolte ed elaborate? In che modo la possibilità di un’integrazione invasiva uomo-robot influisce sul concetto di responsabilità?

Ciò include altri due interrogativi: Il fatto che l’essere umano sia reso “migliore”, conduce a un tipo di responsabilità speciale? Quali sono le conseguenze per coloro i quali sono responsabili di fornire il supporto tecnologico utilizzato per conseguire questo accrescimento?

Nell’affrontare il problema della responsabilità dovremmo considerare l’esistenza di diversi livelli di responsabilità, persino quando si attribuisce la responsabilità ad un individuo, che potrebbe essere ritenuto responsabile di qualcosa inerente il proprio benessere personale, il proprio ambiente sociale (amici, famiglia, comunità), il proprio ruolo specifico (nella sfera professionale o privata) di cittadino che ha delle responsabilità nei confronti della società o dello stato in cui questo qualcuno vive, o, semplicemente, in quanto essere umano. Ciò racchiude inoltre in sé la domanda di se e come la responsabilità possa essere delegata. E se le istituzioni possano essere eticamente responsabili nei confronti dei robot.

I robot sono in misura inferiore al nostro servizio - e questa è una proiezione del desiderio mimetico delle società in cui la schiavitù era acconsentita e/o sostenuta - di quanto non lo sia un qualsiasi altro strumento usato nell’interazione umana. Questo pone delle questioni in termini di diritto alla riservatezza e di fiducia (Arnall 2003, 59) ma anche sul modo in cui noi definiamo noi stessi come persone che lavorano nell’industria, nei servizi e nel campo dell’intrattenimento.

Tutto ciò si riferisce ai diversi approcci culturali presenti in Europa e nelle altre culture rispetto ai robot, che possono avere effetti diversi nel mondo globale.

Culture diverse hanno punti di vista diversi su concetti quali Autonomia e Dignità umana.

Rafael Capurro

Hochschule der Medien Stuttgart

(traduzione a cura di Antonella Magliocchi

e Sabrina Patricelli Malizia)

Bibliografia

- Arnall Alexander Huw, Future Technologies, Today’s Choices. Nanotechnology, Artificial Intelligence and Robotics: A technical, political and institutional map of emerging technologies. A report for the Greenpeace Environmental Trust, 2003.

- Brun Jean, Le rêve et la machine. Technique et Existence, Paris, 2003.

- Capurro Rafael, On Artificiality, IMES (Istituto Metodologico Economico Statistico, Università di Urbino), IMESLCA WP-15 November, 1995. Online: www.capurro.de/artif.htm .

- Girard René, La Violence et le sacré, Grasset, Paris, 1972.

- Lacan Jacques, Le séminaire. Livre VIII. Le transfert, Seuil, Paris, 1991

- Lem Stanislaw, Golem XIV, Krakow, 1981

- Negrotti Massimo, Artificialia. La dimensione artificiale della natura umana, Clueb, Bologna, 1995

- Negrotti Massimo, The Theory of the Artificial, Intellect, Exeter,1999

- Negrotti Massimo, Naturoids. On the Nature of the Artificial, World Scientific, New Jersey, 2002